エンジニアの皆さん、お疲れ様です! 深夜のデプロイ作業後、「メモリ足りない…」「推論速度が遅い…」となるのはもはやエンジニアあるあるですよね。特にAIモデルを組み込んだアプリケーション開発では、モデルサイズと推論速度は常に頭を悩ませる問題です。

スタンフォード大学の研究(2025年発表)によると、大規模言語モデルの推論コストは、学習コストの約10倍に達するとのこと。つまり、モデルを軽量化し、効率的な推論を実現することは、コスト削減だけでなく、アプリケーションのパフォーマンス向上にも不可欠です。

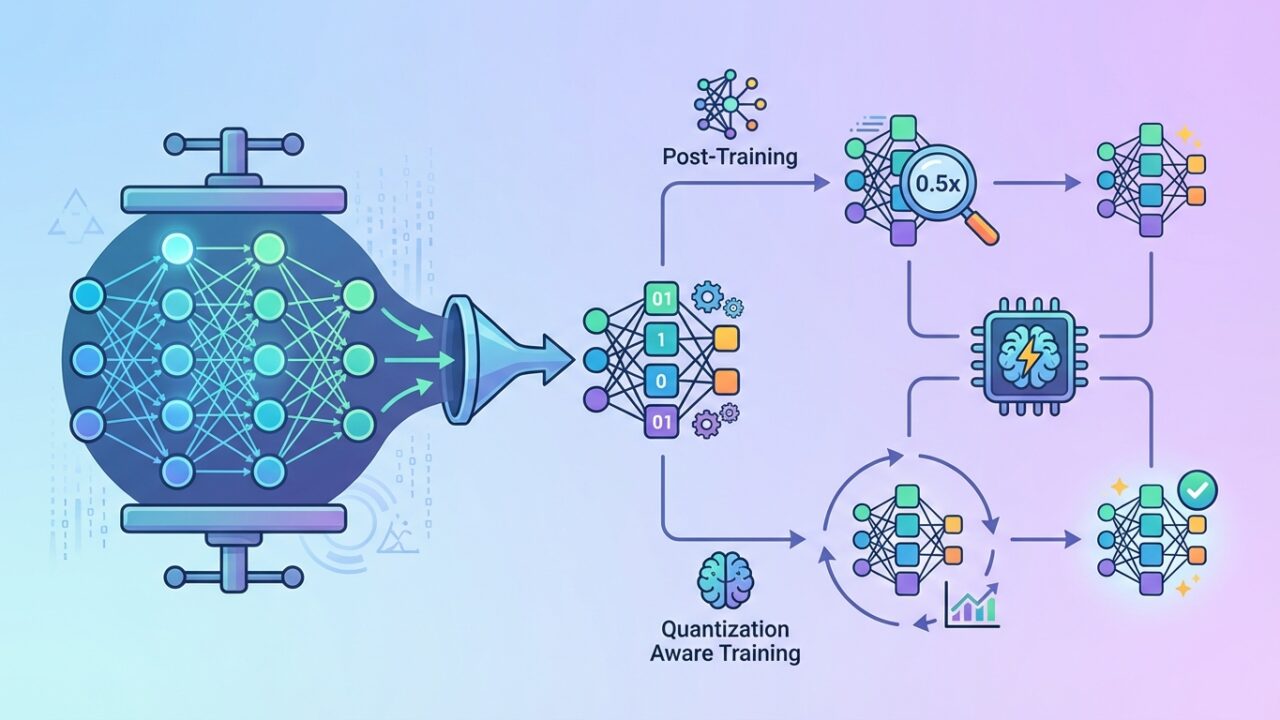

そこで今回は、AIモデルの軽量化に不可欠な技術である量子化に焦点を当て、その種類、メリット・デメリット、そして具体的な実装方法を徹底的に解説します。Post-Training Quantization (PTQ)からQuantization Aware Training (QAT)まで、様々な手法を比較し、あなたのプロジェクトに最適な量子化戦略を見つける手助けをします。

※この記事にはPRが含まれます

AIモデル軽量化における量子化の重要性

AIモデルの量子化とは、モデルのパラメータ(重みと活性化関数)の精度を落とすことで、モデルサイズを縮小し、推論速度を向上させる技術です。通常、AIモデルは32ビット浮動小数点数(FP32)で表現されますが、量子化によって8ビット整数(INT8)やさらに低いビット数に変換できます。

なぜ量子化が必要なのか?

- モデルサイズの縮小: 量子化により、モデルサイズを大幅に削減できます。例えば、FP32モデルをINT8に量子化すると、モデルサイズは約4分の1になります。これは、特にモバイルデバイスやエッジデバイスなど、メモリ容量が限られた環境で重要です。

- 推論速度の向上: 量子化されたモデルは、整数演算に最適化されたハードウェア(例えば、モバイルデバイスのNPUやGPU)で高速に推論できます。

- 消費電力の削減: 整数演算は浮動小数点演算よりも消費電力が少ないため、量子化されたモデルを使用することで、バッテリー駆動時間を延ばすことができます。

量子化の種類:PTQ, QAT, Binary/Ternary Quantization

量子化には様々な種類があり、それぞれに異なる特徴とトレードオフがあります。ここでは、主要な量子化手法であるPost-Training Quantization (PTQ)、Quantization Aware Training (QAT)、そしてBinary/Ternary Quantizationについて解説します。

Post-Training Quantization (PTQ)

PTQは、学習済みのモデルに対して、追加の学習を行わずに量子化を行う手法です。実装が比較的簡単で、迅速にモデルを軽量化できるというメリットがあります。一方で、精度劣化が大きくなる可能性があります。

PTQは通常、キャリブレーションデータと呼ばれる、モデルの入力分布を代表する少量のデータセットを用いて、量子化パラメータ(スケールとゼロ点)を決定します。 TensorFlow Liteの`TFLiteConverter`やPyTorchの`torch.quantization`などがPTQをサポートしています。

import tensorflow as tf

converter = tf.lite.TFLiteConverter.from_saved_model('saved_model')

converter.optimizations = [tf.lite.Optimize.DEFAULT]

def representative_data_gen():

for _ in range(100):

image = tf.random.normal([1, 224, 224, 3]) # 実際のデータに置き換えてください

yield [image]

converter.representative_dataset = representative_data_gen

tflite_model = converter.convert()

with open('quantized_model.tflite', 'wb') as f:

f.write(tflite_model)

Quantization Aware Training (QAT)

QATは、学習中に量子化を考慮した学習を行う手法です。フォワードパスで量子化をシミュレートし、バックプロパゲーションを通じて量子化誤差を学習に組み込みます。PTQよりも精度劣化を抑えることができますが、学習コストが増加するというデメリットがあります。

QATは、モデルのアーキテクチャを一部変更する必要があります。具体的には、量子化ノードをモデルに挿入し、量子化された値でフォワードパスを計算します。PyTorchの`torch.quantization`モジュールやTensorFlow Model Optimization ToolkitなどがQATをサポートしています。

import torch

import torch.nn as nn

import torch.quantization

class MyModel(nn.Module):

def __init__(self):

super().__init__()

self.fc1 = nn.Linear(10, 10)

self.fc2 = nn.Linear(10, 10)

def forward(self, x):

x = torch.relu(self.fc1(x))

x = self.fc2(x)

return x

model = MyModel()

model.qconfig = torch.quantization.get_default_qat_qconfig('fbgemm')

torch.quantization.prepare_qat(model, inplace=True)

optimizer = torch.optim.SGD(model.parameters(), lr=0.01)

for i in range(100):

optimizer.zero_grad()

output = model(torch.randn(1, 10))

loss = torch.sum(output)

loss.backward()

optimizer.step()

model = torch.quantization.convert(model, inplace=True)

torch.save(model.state_dict(), 'quantized_model.pth')

Binary/Ternary Quantization

Binary/Ternary Quantizationは、重みをそれぞれ1ビットまたは2ビットに量子化する手法です。モデルサイズを極限まで削減できますが、精度劣化が非常に大きくなる傾向があります。そのため、通常は特殊なアーキテクチャや学習手法と組み合わせて使用されます。

例えば、XNOR-NetやBinaryConnectなどがBinary Quantizationを用いたモデルの例として挙げられます。これらのモデルは、主にリソースが非常に限られた環境での利用を想定しています。

量子化ツール比較:TensorFlow Lite, PyTorch Mobile, ONNX Runtime

AIモデルの量子化をサポートするツールは数多く存在します。ここでは、代表的なツールであるTensorFlow Lite、PyTorch Mobile、ONNX Runtimeについて、その特徴と使い方を比較します。

TensorFlow Lite

TensorFlow Liteは、モバイルデバイスやエッジデバイスでの推論に最適化されたTensorFlowの軽量版です。PTQとQATの両方をサポートしており、幅広いデバイスで動作します。TensorFlowの`TFLiteConverter`を使用して、TensorFlowモデルをTensorFlow Liteモデルに変換できます。

メリット:

- TensorFlowとの親和性が高い

- 幅広いデバイスをサポート

- PTQとQATの両方をサポート

デメリット:

- TensorFlowに依存する

- 複雑なモデルの量子化は難しい場合がある

PyTorch Mobile

PyTorch Mobileは、モバイルデバイスでの推論に最適化されたPyTorchの軽量版です。PTQとQATの両方をサポートしており、iOSとAndroidの両方で動作します。PyTorchの`torch.quantization`モジュールを使用して、PyTorchモデルを量子化できます。

メリット:

- PyTorchとの親和性が高い

- iOSとAndroidの両方をサポート

- 豊富な量子化オプション

デメリット:

- PyTorchに依存する

- TensorFlow Liteに比べて、サポートされているデバイスが少ない

ONNX Runtime

ONNX Runtimeは、様々なフレームワーク(TensorFlow、PyTorch、scikit-learnなど)で学習されたモデルを、様々なハードウェアで効率的に実行するためのクロスプラットフォームな推論エンジンです。PTQをサポートしており、CPU、GPU、NPUなど、幅広いハードウェアで動作します。ONNX Runtimeの`onnxruntime.quantization`モジュールを使用して、ONNXモデルを量子化できます。

メリット:

- クロスプラットフォームである

- 幅広いハードウェアをサポート

- 様々なフレームワークで学習されたモデルをサポート

デメリット:

- QATをサポートしていない

- PTQのオプションがTensorFlow LiteやPyTorch Mobileに比べて少ない

量子化戦略の選び方:トレードオフを理解する

どの量子化手法を選ぶかは、アプリケーションの要件、利用可能なリソース、そして許容できる精度劣化によって異なります。以下に、量子化戦略を選ぶ際の考慮事項をまとめました。

精度と速度のトレードオフ

量子化は、モデルサイズと推論速度を向上させる一方で、精度を低下させる可能性があります。PTQは実装が簡単ですが、精度劣化が大きくなる傾向があります。QATは精度劣化を抑えることができますが、学習コストが増加します。Binary/Ternary Quantizationはモデルサイズを極限まで削減できますが、精度劣化が非常に大きくなる可能性があります。

ハードウェアの制約

ターゲットとするハードウェアによって、最適な量子化手法が異なります。例えば、モバイルデバイスでは、整数演算に最適化されたNPUを利用することで、量子化の効果を最大限に引き出すことができます。また、一部のハードウェアでは、特定の量子化手法のみがサポートされている場合があります。

開発リソース

量子化の実装には、ある程度の開発リソースが必要です。PTQは比較的簡単に実装できますが、QATはモデルのアーキテクチャを変更する必要があるため、より多くの開発リソースが必要となります。

量子化のベストプラクティス:精度を維持するためのヒント

量子化による精度劣化を最小限に抑えるためには、以下のベストプラクティスを参考にしてください。

- 適切なキャリブレーションデータの使用: PTQを行う場合、モデルの入力分布を代表するキャリブレーションデータを使用することが重要です。

- レイヤーごとの量子化: モデル全体をまとめて量子化するのではなく、レイヤーごとに量子化パラメータを調整することで、精度劣化を抑えることができます。

- QATの活用: 精度が重要な場合は、QATを検討してください。

- 量子化後のモデルの評価: 量子化後のモデルを評価し、精度劣化が許容範囲内であることを確認してください。

まとめ:AIモデル軽量化で未来を切り開く

AIモデルの量子化は、モデルサイズを縮小し、推論速度を向上させるための強力なツールです。PTQ、QAT、Binary/Ternary Quantizationなど、様々な手法を理解し、アプリケーションの要件に合わせて最適な量子化戦略を選択することで、より効率的なAIアプリケーションを開発することができます。

今回の記事が、皆さんのAIモデル軽量化の一助となれば幸いです!