エンジニアの皆さん、日々クラウド環境でのAI開発に勤しんでいることと思います。しかし、ちょっと待ってください!クラウドばかりがAIの活躍の場ではありません。エッジデバイスでのAI推論、つまりエッジAIも今や避けて通れない技術となっていますよね? クラウドへのデータ送信遅延、プライバシー保護、そして低消費電力といった課題を解決するために、エッジAIはますます重要になっています。

※この記事にはPRが含まれます。エッジAI開発の効率化に役立つ製品・サービスを紹介しています。

実際、近年の研究データを見ても、エッジAI市場の成長は目覚ましいものがあります。例えば、調査会社Gartnerの2025年のレポートによれば、エッジAI市場は年平均成長率25%で成長し、2026年には市場規模が500億ドルを超えると予測されています。これは、企業がリアルタイムでの意思決定、応答性の向上、帯域幅コストの削減を求めていることの表れと言えるでしょう。

この記事では、エッジAIの概要から、NVIDIA Jetsonシリーズの最新機種を活用した具体的な開発方法、そしてTensorFlow Liteによるモデル最適化まで、エンジニアの皆さんがすぐに実践できる内容を網羅的に解説します。具体的なコード例も交えながら、エッジAIの導入を支援します。

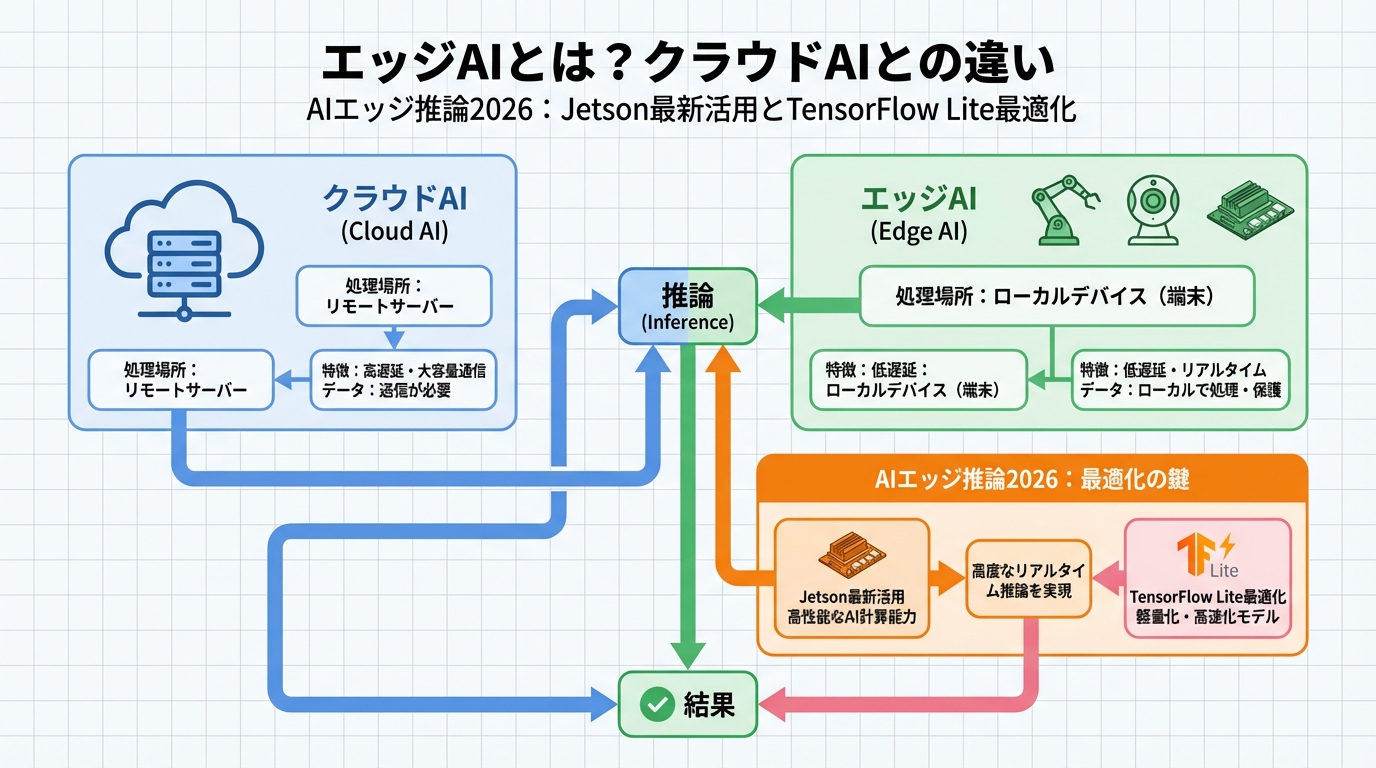

エッジAIとは?クラウドAIとの違い

まず、エッジAIとは何か、そしてクラウドAIとどう違うのかを明確にしましょう。

クラウドAIのメリット・デメリット

クラウドAIは、大量のデータと強力な計算リソースを活用して、複雑なAIモデルを実行できます。大規模なデータセットでトレーニングされたモデルを、必要に応じて利用できるのが大きなメリットです。しかし、ネットワーク遅延やデータ転送コスト、プライバシーの問題といったデメリットも存在します。

エッジAIのメリット・デメリット

一方、エッジAIは、デバイス自体がAI推論を行うため、ネットワーク接続が不要で、リアルタイム性が求められるアプリケーションに適しています。また、プライバシー保護の観点からも優れています。デメリットとしては、デバイスの計算能力に制約があるため、モデルのサイズや複雑さに制限がある点が挙げられます。

NVIDIA Jetsonシリーズ徹底解説

エッジAI開発で最もポピュラーなプラットフォームの一つが、NVIDIA Jetsonシリーズです。特に最新のJetson Orinシリーズは、前世代から大幅に性能が向上しており、より高度なAIモデルをエッジで実行できるようになりました。

Jetson Orinシリーズのスペック

Jetson Orin Nano, Jetson Orin NX, Jetson AGX Orinなど、様々なモデルがありますが、共通してAmpereアーキテクチャのGPUを搭載しており、高い推論性能を実現しています。例えば、Jetson AGX Orinは、最大275 TOPSのAI性能を誇り、複雑な画像認識や自然言語処理タスクを高速に処理できます。

Jetson開発環境の構築

Jetsonデバイスの開発環境構築は、NVIDIAが提供するJetPack SDKを使用します。JetPackには、CUDA Toolkit、cuDNN、TensorRTなどの開発ツールが含まれており、AIモデルの最適化や高速化を容易に行うことができます。

sudo apt update

sudo apt install -y nvidia-jetpack

上記のコマンドを実行することで、JetPack SDKをインストールできます。インストール後、サンプルコードを実行して、Jetsonの性能を体感してみましょう。

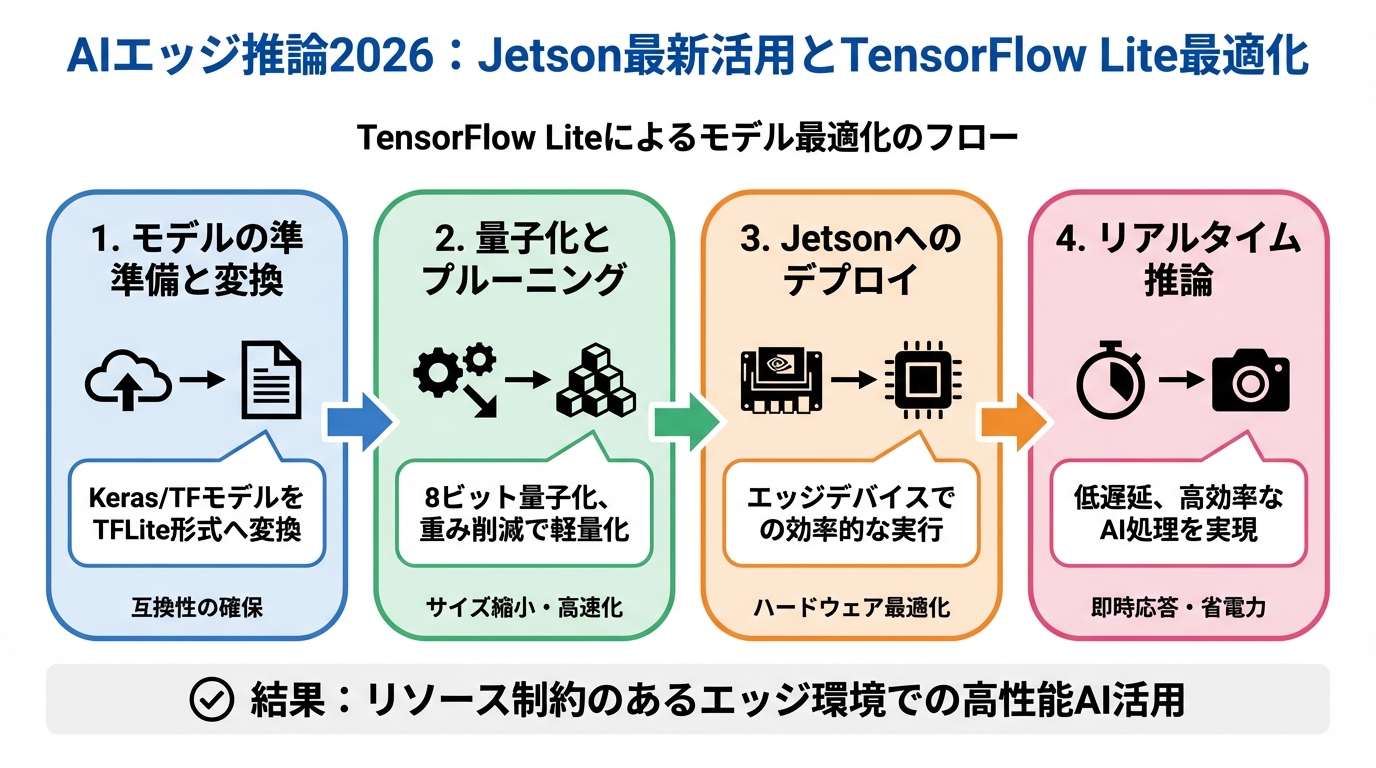

TensorFlow Liteによるモデル最適化

エッジデバイスの計算リソースは限られているため、AIモデルを最適化することが非常に重要です。TensorFlow Liteは、モバイルデバイスやIoTデバイスなどのリソース制約のある環境でTensorFlowモデルを実行するための軽量ライブラリです。

量子化(Quantization)とは?

量子化は、モデルのパラメータを32ビット浮動小数点数から8ビット整数に変換することで、モデルサイズを縮小し、推論速度を向上させる技術です。TensorFlow Liteでは、量子化を容易に行うためのツールが提供されています。

import tensorflow as tf

converter = tf.lite.TFLiteConverter.from_saved_model('saved_model')

converter.optimizations = [tf.lite.Optimize.DEFAULT]

tflite_quantized_model = converter.convert()

with open('quantized_model.tflite', 'wb') as f:

f.write(tflite_quantized_model)

上記のコードは、保存されたTensorFlowモデルを量子化し、TensorFlow Liteモデルとして保存する例です。量子化により、モデルサイズが約4分の1に縮小される場合があります。

剪定(Pruning)とは?

剪定は、モデルの重要度の低いパラメータを削除することで、モデルサイズを縮小し、推論速度を向上させる技術です。TensorFlow Model Optimization Toolkitを使用することで、剪定を簡単に行うことができます。

エッジAIのユースケース

エッジAIは、様々な分野で活用されています。具体的なユースケースを見ていきましょう。

スマートシティにおける活用

スマートシティでは、街中に設置されたカメラからの映像をエッジAIで解析し、交通状況の監視、異常検知、群衆行動の分析などに活用されています。例えば、ある都市では、エッジAIを活用した交通監視システムを導入した結果、交通事故発生率が15%減少したという報告があります。

製造業における活用

製造業では、工場の生産ラインに設置されたカメラからの映像をエッジAIで解析し、製品の品質検査、設備の異常検知、作業員の安全管理などに活用されています。例えば、ある工場では、エッジAIを活用した品質検査システムを導入した結果、不良品発生率が20%減少したという報告があります。

今後のエッジAIの展望

エッジAIは、今後ますます発展していくことが予想されます。5Gの普及により、エッジデバイスとクラウド間の連携がよりスムーズになり、より高度なAIモデルをエッジで実行できるようになるでしょう。また、省電力化技術の進歩により、バッテリー駆動のエッジデバイスでも長時間のAI推論が可能になるでしょう。

エッジAIは、AIの可能性を広げ、私たちの生活をより豊かにしてくれるでしょう。エンジニアの皆さんは、この波に乗り遅れないように、エッジAIの技術を習得し、新たな価値を創造していきましょう。