AIエンジニアの皆さん、日々お疲れ様です!プロジェクトを進める上で、環境構築に時間を取られて本来集中すべきAIモデル開発がおろそかになる…そんな経験、一度や二度ではないはずです。

実際、Stack Overflowの2025年開発者調査によると、開発者の約35%が環境構築に週あたり平均5時間以上を費やしているというデータがあります。これは、年間にして約260時間!貴重な時間を無駄にしている計算になります。

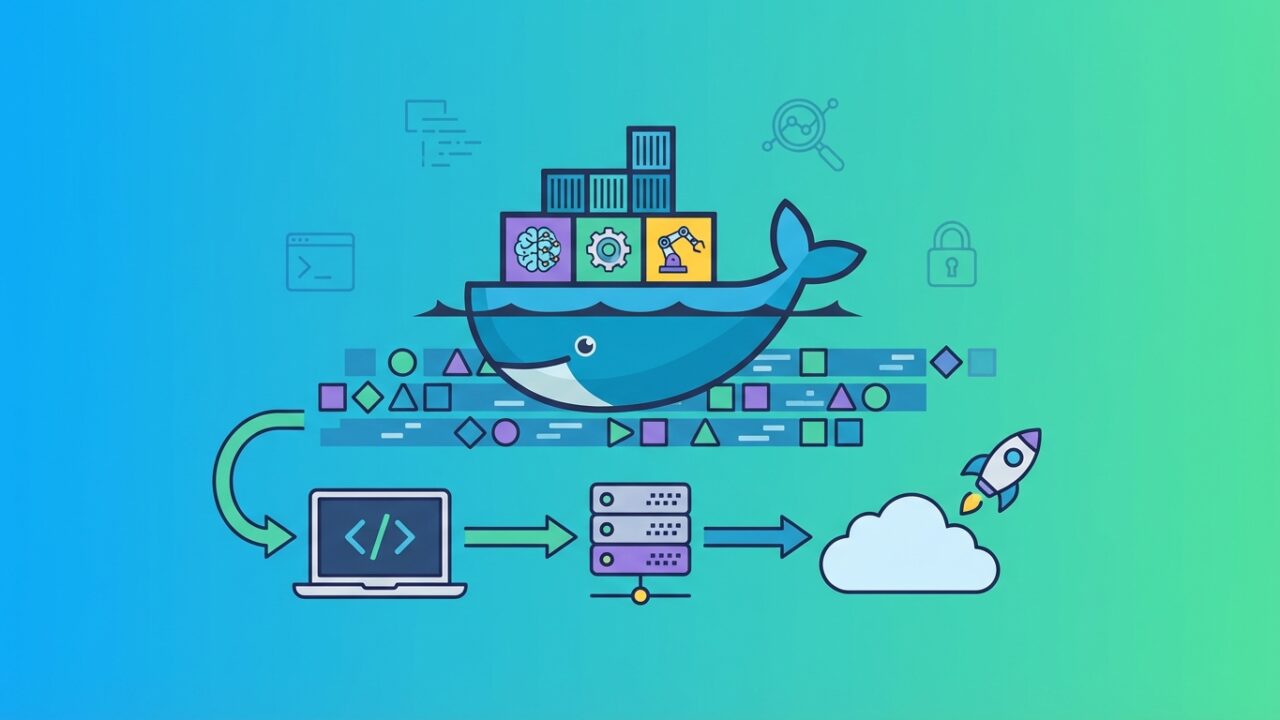

そこで今回は、AI開発における環境構築の課題を解決し、開発効率を飛躍的に向上させるための切り札、Dockerに焦点を当てます。Dockerの基礎から、AI開発における具体的な活用事例、そしてデプロイまで、技術者目線で徹底解説します。この記事を読めば、Dockerを使いこなし、環境構築のストレスから解放されること間違いなしです!

※この記事にはPRが含まれます

Dockerとは?基本とメリット

Dockerの基本概念

Dockerは、コンテナと呼ばれる仮想化技術を用いて、アプリケーションとその依存関係をパッケージ化し、隔離された環境で実行するためのプラットフォームです。コンテナは、OSカーネルを共有するため、従来の仮想マシンよりも軽量で高速に動作します。

- イメージ: アプリケーションを実行するためのテンプレート。

- コンテナ: イメージから作成された実行可能なインスタンス。

- Docker Hub: イメージを共有するためのレジストリ。

Dockerのメリット:AI開発における恩恵

Dockerは、AI開発において以下のようなメリットをもたらします。

- 環境の一貫性: 開発、テスト、本番環境で同じ環境を再現できるため、環境依存の問題を解消できます。

- 再現性: Dockerfileと呼ばれる設定ファイルを用いて、環境構築の手順をコードとして管理できるため、環境を再現しやすくなります。

- ポータビリティ: コンテナは、様々なプラットフォームで実行できるため、異なる環境への移行が容易になります。

- 高速な起動: コンテナは、従来の仮想マシンよりも高速に起動できるため、開発効率が向上します。

AI開発におけるDockerの活用事例

TensorFlow/PyTorch環境の構築

AI開発で最もよく使われるフレームワークであるTensorFlowやPyTorchの環境構築は、依存関係が複雑で手間がかかります。Dockerを使用することで、これらのフレームワークを簡単に構築し、管理することができます。

FROM nvidia/cuda:11.8.0-cudnn8-devel-ubuntu22.04

RUN apt-get update && apt-get install -y --no-install-recommends \

python3-pip \

python3-dev \

&& rm -rf /var/lib/apt/lists/*

RUN pip3 install --upgrade pip

RUN pip3 install tensorflow==2.13.0

WORKDIR /app

COPY . .

CMD ["python3", "./your_script.py"]

上記のDockerfileは、TensorFlow 2.13.0をインストールする例です。同様の手順で、PyTorchやその他の必要なライブラリをインストールできます。

Jupyter Notebook環境の構築

Jupyter Notebookは、AI開発においてデータ分析やモデルのプロトタイピングに広く使用されています。Dockerを使用することで、Jupyter Notebook環境を簡単に構築し、共有することができます。

FROM python:3.9

WORKDIR /app

COPY requirements.txt .

RUN pip install -r requirements.txt

COPY . .

EXPOSE 8888

CMD ["jupyter", "notebook", "--ip", "0.0.0.0", "--port", "8888", "--allow-root", "--no-browser"]

このDockerfileは、`requirements.txt`ファイルに記述された依存関係をインストールし、Jupyter Notebookをポート8888で起動します。

データ分析環境の構築

Pandas、NumPy、Scikit-learnなどのデータ分析ライブラリを含む環境をDockerで構築することで、分析環境の統一化と再現性を確保できます。チーム全体で同じ環境を共有することで、分析結果の差異を減らし、共同作業をスムーズに進めることができます。

Docker Compose:複数コンテナの連携を簡単に

Docker Composeとは?

Docker Composeは、複数のDockerコンテナを定義し、実行するためのツールです。複雑なアプリケーションを構成する複数のコンテナを、一つのYAMLファイルで管理することができます。

Docker Composeのメリット

- 簡潔な定義: 複数のコンテナをYAMLファイルで一元的に定義できます。

- 依存関係の管理: コンテナ間の依存関係を定義し、起動順序を制御できます。

- 容易な実行: `docker-compose up`コマンド一つで、複数のコンテナをまとめて起動できます。

AIアプリケーションのDocker Compose例

例えば、AIモデルを提供するAPIサーバーと、データベースを連携させる場合、以下のような`docker-compose.yml`ファイルを作成できます。

version: "3.9"

services:

api:

build: ./api

ports:

- "8000:8000"

depends_on:

- db

environment:

- DATABASE_URL=postgresql://user:password@db:5432/database

db:

image: postgres:14

environment:

- POSTGRES_USER=user

- POSTGRES_PASSWORD=password

- POSTGRES_DB=database

volumes:

- db_data:/var/lib/postgresql/data

volumes:

db_data:

この例では、APIサーバーとPostgreSQLデータベースの2つのコンテナを定義しています。`depends_on`でAPIサーバーがデータベースに依存していることを示し、`docker-compose up`コマンドで両方のコンテナが適切な順序で起動されます。

Docker Hub/Container Registry:イメージの共有と管理

Docker Hubとは?

Docker Hubは、Dockerイメージを共有するためのクラウドベースのレジストリです。公開されているイメージを自由に利用できるほか、プライベートなイメージを保存することもできます。

Container Registryとは?

Container Registryは、Dockerイメージを保存および管理するためのプライベートなレジストリです。企業内で開発したイメージを安全に共有するために利用されます。AWS ECR、Google Container Registry、Azure Container Registryなどが代表的なサービスです。

イメージの共有と管理のベストプラクティス

- タグの活用: イメージにバージョン番号やビルドIDなどのタグを付けて、管理を容易にしましょう。

- Dockerfileの最適化: イメージサイズを削減するために、Dockerfileを最適化しましょう。

- 脆弱性スキャン: イメージに脆弱性がないか定期的にスキャンしましょう。

- イメージの署名: イメージの信頼性を確保するために、署名を利用しましょう。

Dockerを使ったAIモデルのデプロイ

ローカル環境からクラウドへのデプロイ

Dockerで構築したAIモデルを、ローカル環境からクラウド環境(AWS、Google Cloud、Azureなど)へデプロイする方法を解説します。

- イメージの作成: DockerfileからDockerイメージを作成します。

- イメージのプッシュ: 作成したイメージをDocker HubまたはContainer Registryにプッシュします。

- クラウド環境での実行: クラウド環境で、プッシュしたイメージを使用してコンテナを実行します。各クラウドプラットフォームには、コンテナを実行するためのマネージドサービス(例:AWS ECS、Google Kubernetes Engine、Azure Container Instances)が用意されています。

Kubernetesとの連携

大規模なAIアプリケーションのデプロイには、コンテナオーケストレーションツールであるKubernetesが適しています。DockerイメージをKubernetesにデプロイすることで、スケーラビリティ、可用性、管理性を向上させることができます。

apiVersion: apps/v1

kind: Deployment

metadata:

name: ai-model-deployment

spec:

replicas: 3

selector:

matchLabels:

app: ai-model

template:

metadata:

labels:

app: ai-model

spec:

containers:

- name: ai-model-container

image: your-dockerhub-username/ai-model:latest

ports:

- containerPort: 8000

上記のDeploymentファイルは、`your-dockerhub-username/ai-model:latest`イメージを使用して、AIモデルを3つのレプリカで実行します。

まとめ:Dockerを使いこなし、AI開発を加速させよう!

今回は、AI開発におけるDockerの活用方法について解説しました。Dockerを使いこなすことで、環境構築のストレスから解放され、開発効率を飛躍的に向上させることができます。ぜひ、Dockerを導入して、AI開発を加速させましょう!