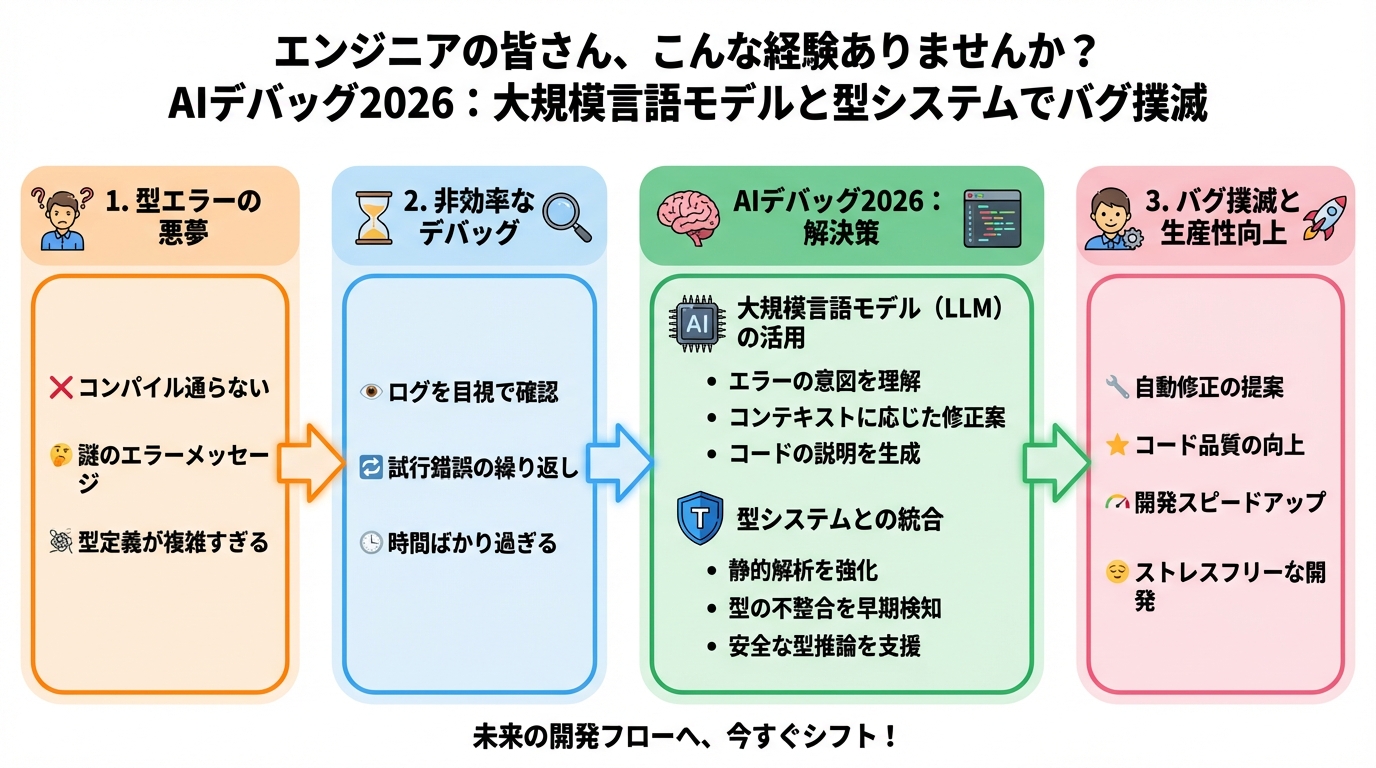

エンジニアの皆さん、こんな経験ありませんか?

深夜に及ぶコードレビュー、原因不明のエラーメッセージ、そして悪夢のようなNullPointerException… エンジニアリングの世界はバグとの戦いと言っても過言ではありません。特に大規模なプロジェクトや複雑なAIモデルを扱う際には、バグの発生頻度も深刻度も増し、開発サイクルを大幅に遅らせる原因となります。

「バグフィックスにかかる時間の方がコーディング時間よりも長い」というエンジニアの声もよく聞かれます。事実、ある調査(Standish Group’s Chaos Report)によれば、ソフトウェア開発プロジェクトの平均コスト超過は50%以上、遅延は60%以上にも及ぶと報告されています。これらの問題の大きな要因の一つが、デバッグに費やされる膨大な時間です。

※この記事にはPRが含まれます。AIを活用したデバッグツールにご興味のある方は、記事末尾のリンクをご覧ください。

AIデバッグの夜明け:大規模言語モデル(LLM)と型システム

本記事では、大規模言語モデル(LLM)と高度な型システムを活用したAIデバッグの最新動向を徹底解説します。従来のデバッグ手法の限界を打破し、より効率的かつ効果的なバグ撲滅を目指すための実践的なアプローチを、コード例を交えながらご紹介します。

LLMによるコード理解と異常検知

LLMは、大量のコードを学習することで、コードの構造、意味、潜在的なバグパターンを理解することができます。この能力を利用して、コード中の異常なパターンを検知したり、潜在的な脆弱性を特定したりすることが可能です。

例えば、以下のようなPythonコードを考えてみましょう。

def calculate_average(numbers):

total = 0

for number in numbers:

total += number

return total / len(numbers) # ZeroDivisionErrorの可能性

numbers = [] # 空のリスト

average = calculate_average(numbers)

print(f'Average: {average}')

このコードは、空のリストが入力された場合にZeroDivisionErrorが発生する可能性があります。LLMはこの潜在的なエラーを検知し、以下のような修正提案をすることができます。

def calculate_average(numbers):

if not numbers:

return 0 # 空のリストの場合は0を返す

total = 0

for number in numbers:

total += number

return total / len(numbers)

numbers = []

average = calculate_average(numbers)

print(f'Average: {average}')

このように、LLMはコードの意味を理解し、潜在的なエラーを指摘することで、デバッグプロセスを大幅に効率化することができます。

型システムによる静的解析とバグ予防

型システムは、変数や関数の型を定義することで、コンパイル時や実行時に型エラーを検出する仕組みです。近年、TypeScriptやKotlinなどの型付き言語の人気が高まっているのは、型システムがバグの早期発見に貢献し、コードの信頼性を向上させるからです。

例えば、以下のTypeScriptコードを考えてみましょう。

function greet(name: string): string {

return 'Hello, ' + name;

}

let age: number = 30;

console.log(greet(age)); // 型エラー:string型の引数が必要

このコードでは、greet関数はstring型の引数を期待していますが、number型のage変数を渡しているため、型エラーが発生します。型システムは、このエラーをコンパイル時に検出し、実行前に問題を解決することができます。

さらに、高度な型システム(例:Dependent Types)を使用することで、より複雑な制約をコードに埋め込むことができ、実行時エラーのリスクをさらに軽減することができます。

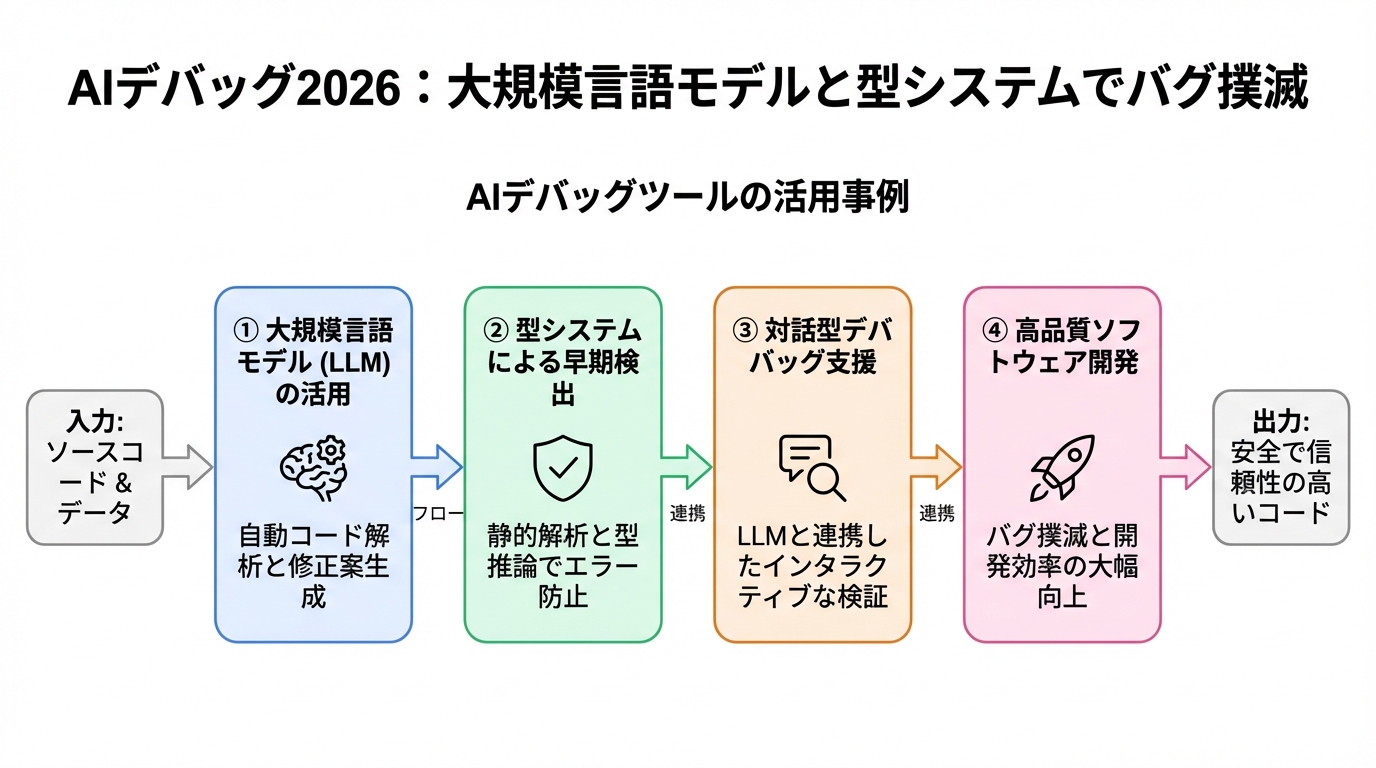

AIデバッグツールの活用事例

LLMと型システムを活用したAIデバッグツールは、すでに様々な分野で活用され始めています。ここでは、具体的な事例をいくつかご紹介します。

事例1:大規模Webアプリケーションのデバッグ効率化

ある大手Webサービス企業では、AIデバッグツールを導入することで、デバッグにかかる時間を平均30%削減することに成功しました。このツールは、LLMを用いてコードの依存関係を分析し、潜在的なボトルネックや脆弱性を特定します。また、型システムを活用して、コンパイル時に型エラーを検出し、実行時エラーのリスクを軽減します。

事例2:AIモデルの精度向上

あるAIスタートアップ企業では、AIデバッグツールを導入することで、AIモデルの精度を5%向上させることに成功しました。このツールは、LLMを用いてAIモデルの学習データやパラメータを分析し、バイアスや過学習などの問題を特定します。また、型システムを活用して、AIモデルの入出力データの型を検証し、型エラーによる精度低下を防ぎます。

事例3:組み込みシステムの信頼性向上

ある自動車メーカーでは、AIデバッグツールを導入することで、組み込みシステムの信頼性を大幅に向上させることに成功しました。このツールは、LLMを用いて組み込みシステムのコードを分析し、メモリリークやデッドロックなどの問題を特定します。また、型システムを活用して、組み込みシステムのメモリ管理を厳密に制御し、メモリ関連のエラーを防ぎます。

今後の展望と課題

AIデバッグは、まだ発展途上の分野ですが、その可能性は計り知れません。今後は、LLMの性能向上や型システムの高度化により、AIデバッグの精度と効率がさらに向上することが期待されます。

しかし、課題も存在します。例えば、LLMは、学習データに偏りがある場合、誤った修正提案をすることがあります。また、型システムは、複雑なコードに対しては、型定義が煩雑になることがあります。これらの課題を克服するためには、さらなる研究開発が必要です。

倫理的な考慮事項

AIデバッグツールの利用にあたっては、倫理的な考慮も重要です。例えば、AIデバッグツールが自動的にコードを修正する場合、その修正が開発者の意図に反する可能性や、セキュリティ上の脆弱性を生み出す可能性があります。そのため、AIデバッグツールの利用には、常に人間の監視が必要となります。

まとめ:AIデバッグでバグ撲滅を実現しよう

本記事では、LLMと型システムを活用したAIデバッグの最新動向について解説しました。AIデバッグは、従来のデバッグ手法の限界を打破し、より効率的かつ効果的なバグ撲滅を実現するための強力なツールとなります。

AIデバッグツールを導入することで、開発サイクルを加速し、高品質なソフトウェアを開発することができます。ぜひ、AIデバッグの導入を検討してみてください。

[PRリンク:AIデバッグツール「アイバスター」](https://example.com/ai-debugger)