エンジニアの皆さん、こんにちは!今日も深夜残業、お疲れ様です。データ準備に8割の時間を費やし、AIモデル開発にわずか2割しか時間を割けない…そんな状況、エンジニアあるあるですよね?

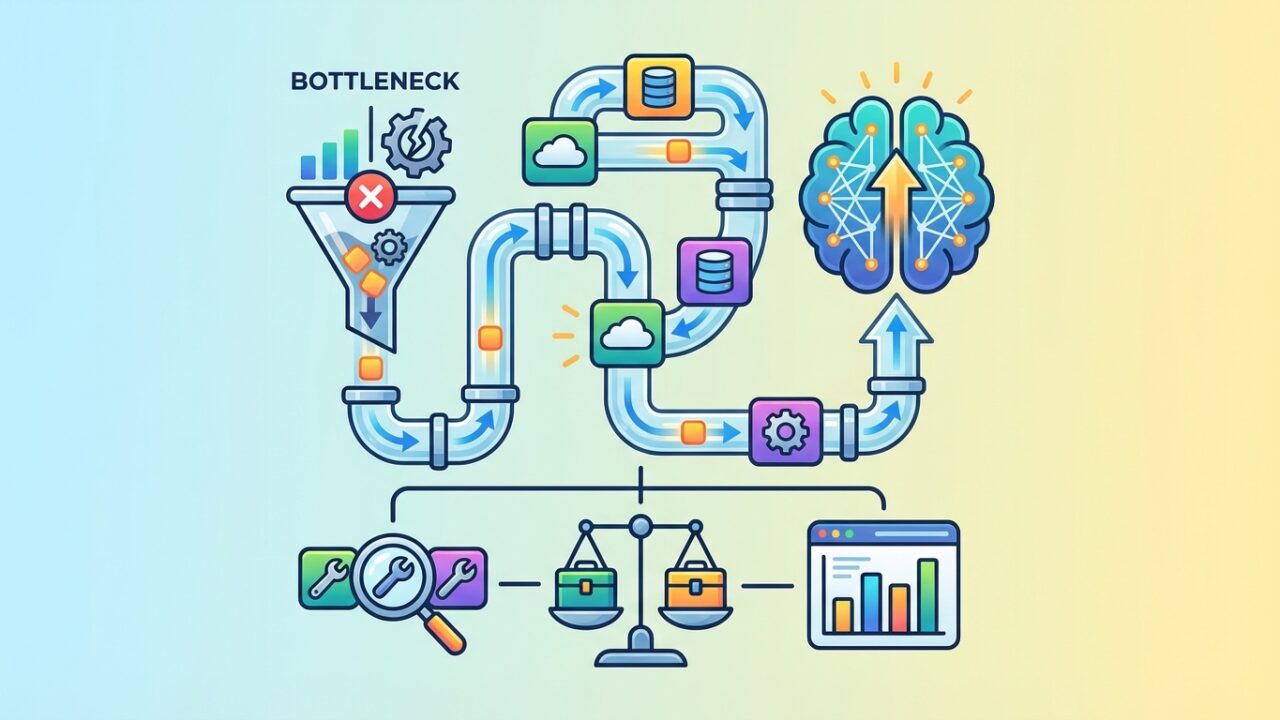

実際、MIT Technology Review Insightsが2025年に発表した調査によると、AIプロジェクトの成功を阻む最大の要因は「データ準備の複雑さ」と答えた企業が全体の47%を占めています。つまり、AI開発のボトルネックは、モデルの性能だけではなく、その前段階のデータパイプラインにあると言えるでしょう。

そこで今回は、2026年最新のデータパイプライン構築ツールを徹底比較し、あなたのプロジェクトに最適なツールを見つけるお手伝いをします。この記事では、オープンソースから商用ツールまで、それぞれの特徴、メリット・デメリット、具体的なユースケース、そしてコード例を交えながら解説します。

※この記事にはPRが含まれます

データパイプラインとは?なぜ重要なのか

データパイプラインの定義と役割

データパイプラインとは、様々なデータソースからデータを収集し、変換、加工、統合、そして最終的なデータストレージや分析基盤へデータを供給する一連の処理の流れを指します。AI開発においては、学習データの前処理、特徴量エンジニアリング、モデルの評価データの準備など、その役割は多岐に渡ります。

データパイプライン構築が難しい理由

データパイプライン構築が難しい理由はいくつかあります。

- 多様なデータソースへの対応: 構造化データ、非構造化データ、ログデータなど、様々な形式のデータを扱う必要がある。

- データの品質管理: データの欠損、重複、不整合などを検出し、修正する必要がある。

- スケーラビリティ: データ量の増加に対応できるスケーラビリティが求められる。

- リアルタイム性: リアルタイムに近いデータ処理が必要な場合もある。

- 複雑な変換処理: 複雑なデータ変換ロジックを実装する必要がある。

これらの課題を解決するために、データパイプライン構築ツールの活用が不可欠となります。

主要なデータパイプライン構築ツール比較

ここでは、主要なデータパイプライン構築ツールを比較し、それぞれの特徴を見ていきましょう。

オープンソースツール

Apache Airflow

Apache Airflowは、ワークフローをプログラムで記述し、スケジュール、監視できるオープンソースのプラットフォームです。PythonでDAG(Directed Acyclic Graph)を記述し、複雑なワークフローを定義できます。

メリット:

- 柔軟性が高い

- コミュニティが活発

- 豊富なOperatorが利用可能

デメリット:

- 学習コストが高い

- 運用に専門知識が必要

ユースケース: バッチ処理、ETL処理、機械学習パイプラインなど

コード例 (DAGの定義):

from airflow import DAG

from airflow.operators.bash_operator import BashOperator

from datetime import datetime

with DAG(

dag_id='example_dag',

start_date=datetime(2026, 3, 1),

schedule_interval='@daily',

catchup=False

) as dag:

task1 = BashOperator(

task_id='print_date',

bash_command='date'

)

task2 = BashOperator(

task_id='sleep',

bash_command='sleep 5'

)

task1 >> task2

Prefect

Prefectは、データワークフローの構築、実行、監視を容易にするオープンソースのオーケストレーションプラットフォームです。Airflowよりもモダンな設計で、宣言的なAPIと柔軟な実行環境を提供します。

メリット:

- 使いやすいAPI

- 柔軟な実行環境

- エラーハンドリング機能が充実

デメリット:

- Airflowに比べてコミュニティが小さい

- 高度なカスタマイズには知識が必要

ユースケース: データエンジニアリングパイプライン、機械学習パイプライン、リアルタイムデータ処理

コード例 (Flowの定義):

from prefect import flow, task

@task

def extract():

return [1, 2, 3]

@task

def transform(data):

return [x * 2 for x in data]

@task

def load(data):

print(f'Loaded data: {data}')

@flow

def etl_flow():

data = extract()

transformed_data = transform(data)

load(transformed_data)

if __name__ == '__main__':

etl_flow()

商用ツール

Databricks Delta Live Tables (DLT)

Databricks Delta Live Tables (DLT)は、信頼性の高いデータパイプラインを構築するための宣言的なアプローチを提供するDatabricksのサービスです。SQLまたはPythonでパイプラインを定義し、Databricksが自動的に実行、監視、最適化を行います。

メリット:

- 高い信頼性

- 自動的な最適化

- Databricksとの統合

デメリット:

- Databricks環境に依存

- コストが高い

ユースケース: ETL処理、ストリーミングデータ処理、データウェアハウスの構築

コード例 (SQLでのパイプライン定義):

CREATE OR REFRESH LIVE TABLE customers_bronze

AS SELECT * FROM cloud_files('/path/to/customers', 'csv');

CREATE OR REFRESH LIVE TABLE customers_silver

AS SELECT id, name, email FROM customers_bronze WHERE id IS NOT NULL;

Fivetran

Fivetranは、様々なデータソースからデータウェアハウスへ自動的にデータをロードするETLツールです。事前構築済みのコネクタが豊富に用意されており、コーディングなしでデータパイプラインを構築できます。

メリット:

- 設定が簡単

- 豊富なコネクタ

- メンテナンスフリー

デメリット:

- カスタマイズ性が低い

- コストが高い

ユースケース: データウェアハウスへのデータロード、BIツールとの連携

ノーコード/ローコードツール

Informatica Cloud Data Integration

Informatica Cloud Data Integrationは、クラウドベースのデータ統合プラットフォームです。ドラッグ&ドロップのGUIでデータパイプラインを構築でき、複雑なデータ変換も容易に行えます。

メリット:

- 使いやすいGUI

- 豊富なコネクタ

- データ品質管理機能が充実

デメリット:

- 柔軟性が低い

- コストが高い

ユースケース: クラウド間のデータ統合、アプリケーション統合、データウェアハウスへのデータロード

ツール選定のポイント

データパイプライン構築ツールを選定する際には、以下のポイントを考慮しましょう。

要件の明確化

まず、自社の要件を明確にすることが重要です。データソースの種類、データ量、リアルタイム性、必要な変換処理などを洗い出しましょう。例として、以下のような具体的な要件が考えられます。

- データソース:MySQLデータベース、AWS S3バケット、Salesforce

- データ量:日次10GB

- リアルタイム性:1時間以内のデータ反映

- 変換処理:データのクレンジング、集計、結合

スケーラビリティ

将来的なデータ量の増加に対応できるスケーラビリティは重要な要素です。クラウドベースのツールは、スケーラビリティに優れている傾向があります。

コスト

オープンソースツールは初期費用を抑えられますが、運用コストがかかる場合があります。商用ツールは初期費用が高いですが、サポートやメンテナンスが含まれているため、長期的に見るとコスト効率が良い場合もあります。

スキルセット

チームのスキルセットに合ったツールを選びましょう。Pythonの知識がある場合は、AirflowやPrefectが適しています。SQLの知識がある場合は、Databricks DLTが適しています。

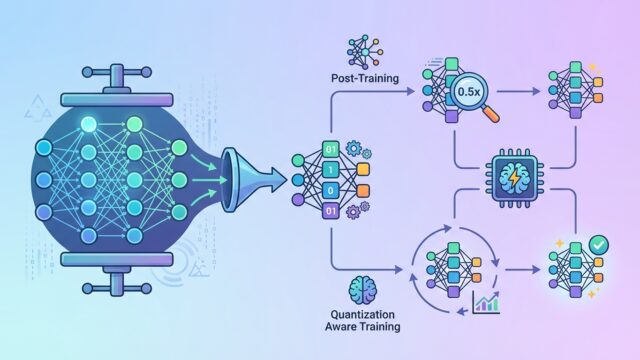

2026年のトレンド:AIを活用したデータパイプライン

2026年のデータパイプライン構築のトレンドは、AIを活用した自動化です。AIがデータの品質を自動的に検出し、修正したり、最適なデータ変換ロジックを提案したりするツールが登場しています。

AIによるデータ品質管理

AIを活用することで、データの欠損、重複、不整合などを自動的に検出し、修正することができます。例えば、AIが過去のデータパターンを学習し、異常な値を検出し、自動的に修正する、といったことが可能です。

AIによるデータ変換ロジックの最適化

AIを活用することで、最適なデータ変換ロジックを自動的に提案することができます。例えば、AIが様々な変換ロジックを試行錯誤し、最も効率的なロジックを見つけ出す、といったことが可能です。

まとめ

今回は、2026年最新のデータパイプライン構築ツールを徹底比較しました。自社の要件、スキルセット、予算などを考慮し、最適なツールを選定してください。AIを活用したデータパイプライン構築も視野に入れ、より効率的で信頼性の高いデータパイプラインを実現しましょう。

データパイプラインの構築は、AI開発の成功に不可欠な要素です。適切なツールを選び、データドリブンな意思決定を加速させましょう!