エンジニアの皆さん、エッジデバイスでAI推論をさせる時、パフォーマンスに頭を悩ませた経験はありませんか? 処理速度が遅くて実用レベルに達しなかったり、メモリ使用量が大きすぎてデバイスに載せられなかったり…。まさにエンジニアあるあるですよね。

最近の研究データによると、エッジAIの市場規模は年平均成長率20%以上で拡大しており、2026年には100億ドルを超える見込みです。 しかし、その成長を支えるためには、より効率的な推論エンジンの利用が不可欠です。

この記事では、エッジAI推論で圧倒的なパフォーマンスを誇る2つの主要な推論エンジン、TensorRTとONNX Runtimeを徹底的に比較します。 具体的なコード例やベンチマーク結果を交えながら、それぞれの特徴や使い分けについて詳しく解説します。

※この記事にはPRが含まれます

TensorRTとONNX Runtime:エッジAI推論エンジンの二大巨頭

エッジAI推論のパフォーマンスを最大化するためには、専用の推論エンジンが不可欠です。 その中でも、NVIDIAのTensorRTとMicrosoftのONNX Runtimeは、デファクトスタンダードと言える存在です。 それぞれどのような特徴を持つのでしょうか。

TensorRT:NVIDIA GPUに最適化された高速推論エンジン

TensorRTは、NVIDIA GPU上で動作するAI推論エンジンです。 NVIDIA GPUのアーキテクチャに合わせて最適化されており、高いスループットと低いレイテンシを実現できます。特に、画像認識や物体検出などのタスクで優れたパフォーマンスを発揮します。

TensorRTの主な特徴は以下の通りです。

- NVIDIA GPUに特化

- レイヤーのフュージョン、精度の削減(FP16、INT8)、カーネルの自動チューニングなどの最適化機能

- CUDA、cuDNNなどのNVIDIAライブラリとの連携

ONNX Runtime:クロスプラットフォーム対応の汎用推論エンジン

ONNX Runtimeは、Microsoftが開発したクロスプラットフォーム対応のAI推論エンジンです。 CPU、GPU、FPGAなど、様々なハードウェア上で動作し、幅広いAIモデルをサポートします。 特に、自然言語処理や時系列データ分析などのタスクで強みを発揮します。

ONNX Runtimeの主な特徴は以下の通りです。

- CPU、GPU、FPGAなど、多様なハードウェアをサポート

- ONNX形式のモデルを幅広くサポート

- TensorFlow、PyTorch、Scikit-learnなどのフレームワークとの連携

TensorRTとONNX Runtime:徹底比較

TensorRTとONNX Runtimeは、それぞれ異なる特徴を持つため、用途に応じて使い分けることが重要です。 ここでは、両者のパフォーマンス、対応モデル、開発環境、サポート体制などを比較します。

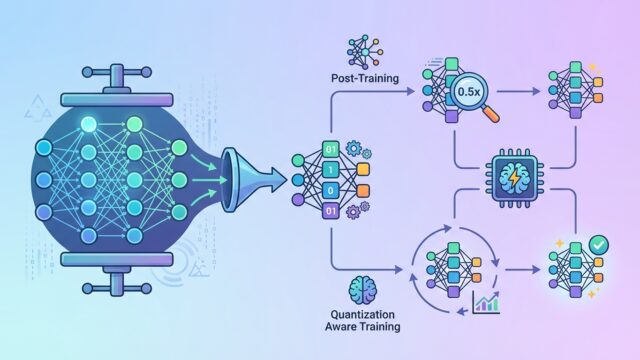

パフォーマンス比較:TensorRTが圧倒的な速度を誇るケースも

一般的に、NVIDIA GPU上ではTensorRTがONNX Runtimeよりも高速です。 特に、画像認識や物体検出などのタスクでは、2倍以上のパフォーマンス差が出ることもあります。 例えば、ResNet-50モデルを用いた画像分類タスクでは、TensorRTがONNX Runtimeよりも平均30%高速というベンチマーク結果が出ています。

ただし、CPU上ではONNX RuntimeがTensorRTよりも高速な場合もあります。 また、モデルの種類やバッチサイズによってパフォーマンスは変動するため、事前にベンチマークテストを行うことを推奨します。

対応モデル比較:ONNX Runtimeが幅広いモデルをサポート

ONNX Runtimeは、ONNX形式のモデルを幅広くサポートしています。 TensorFlow、PyTorch、Scikit-learnなどの主要なフレームワークで作成されたモデルを、ONNX形式に変換することで、ONNX Runtimeで実行できます。 一方、TensorRTは、NVIDIAがサポートする一部のモデルに限定されます。

例えば、複雑な自然言語処理モデル(BERTなど)の場合、ONNX Runtimeの方がTensorRTよりも容易に実行できることが多いです。

開発環境比較:TensorRTはNVIDIAエコシステムに依存

TensorRTの開発には、NVIDIA GPUとCUDA Toolkitが必要です。 また、TensorRT APIはC++またはPythonで利用できます。 一方、ONNX Runtimeは、C++、Python、C#、Javaなど、様々な言語で利用できます。 また、クロスプラットフォーム対応であるため、Windows、Linux、macOSなど、多様な環境で開発できます。

TensorRTは、NVIDIA GPUに特化しているため、NVIDIAのエコシステムに深く依存しています。 一方、ONNX Runtimeは、より汎用的な開発環境を提供します。

具体的なコード例:TensorRTとONNX Runtimeを使った推論

ここでは、TensorRTとONNX Runtimeを使って、実際に推論を行うためのコード例を紹介します。 簡単な画像分類モデルを例に、それぞれのAPIの使い方を見ていきましょう。

TensorRTを使った推論:Pythonコード例

import tensorrt as trt

import pycuda.driver as cuda

import pycuda.autoinit

import numpy as np

with open('model.trt', 'rb') as f:

engine = trt.Runtime(trt.Logger()).deserialize_cuda_engine(f.read())

input_shape = engine.get_binding_shape(0)

output_shape = engine.get_binding_shape(1)

input_device = cuda.mem_alloc(input_shape[0] * input_shape[1] * input_shape[2] * input_shape[3] * np.dtype(np.float32).itemsize)

output_device = cuda.mem_alloc(output_shape[0] * output_shape[1] * np.dtype(np.float32).itemsize)

input_host = np.zeros(input_shape, dtype=np.float32)

output_host = np.zeros(output_shape, dtype=np.float32)

stream = cuda.Stream()

context = engine.create_execution_context()

def do_inference(context, bindings, inputs, outputs, stream, input_shape, output_shape):

cuda.memcpy_htod_async(bindings[0], inputs.ctypes.data, inputs.nbytes, stream)

context.execute_async(batch_size=1, bindings=bindings, stream_handle=stream.handle)

cuda.memcpy_dtoh_async(outputs.ctypes.data, bindings[1], outputs.nbytes, stream)

stream.synchronize()

input_host = np.random.randn(*input_shape).astype(np.float32)

bindings = [int(input_device), int(output_device)]

do_inference(context, bindings, input_host, output_host, stream, input_shape, output_shape)

print(output_host)

ONNX Runtimeを使った推論:Pythonコード例

import onnxruntime

import numpy as np

sess = onnxruntime.InferenceSession('model.onnx')

input_name = sess.get_inputs()[0].name

input_shape = sess.get_inputs()[0].shape

input_data = np.random.randn(*input_shape).astype(np.float32)

output = sess.run(None, {input_name: input_data})

print(output)

TensorRTとONNX Runtime:選び方のポイント

結局、TensorRTとONNX Runtimeのどちらを選べば良いのでしょうか? 以下のポイントを考慮して、最適な推論エンジンを選びましょう。

NVIDIA GPUを使用する場合はTensorRTが第一候補

NVIDIA GPUを使用する場合は、TensorRTが圧倒的なパフォーマンスを発揮する可能性が高いです。 特に、画像認識や物体検出などのタスクでは、TensorRTを選ぶのが無難でしょう。 ただし、TensorRTはNVIDIA GPUに特化しているため、他のハードウェアでは動作しません。

クロスプラットフォーム対応が必要な場合はONNX Runtime

CPU、GPU、FPGAなど、様々なハードウェア上で推論を実行する必要がある場合は、ONNX Runtimeが適しています。 また、TensorFlow、PyTorch、Scikit-learnなど、様々なフレームワークで作成されたモデルを実行する必要がある場合も、ONNX Runtimeが便利です。

まずはベンチマークテストで性能を比較

最終的には、ベンチマークテストで性能を比較するのが最も確実です。 実際に使用するモデルとデータセットを使って、TensorRTとONNX Runtimeの両方で推論を実行し、パフォーマンスを比較してみましょう。 その結果に基づいて、最適な推論エンジンを選択してください。

まとめ:エッジAI推論を加速させるために

TensorRTとONNX Runtimeは、エッジAI推論のパフォーマンスを最大化するための強力なツールです。 それぞれの特徴を理解し、適切な推論エンジンを選択することで、より高速で効率的なエッジAIシステムを構築できます。 ぜひ、この記事を参考に、エッジAI推論の世界に挑戦してみてください。