エンジニアの皆さん、日々の開発業務お疲れ様です!

デプロイ時の謎のエラー、コンフリクト地獄、そして終わらないテスト…

プロダクション環境で突如発生する原因不明のバグ…ありますよね?

実は、2025年に発表されたGoogle Researchの調査によると、DevOpsチームの平均的なデプロイ頻度は、AIと自動化ツールを高度に活用しているチームの方が、そうでないチームに比べて3.2倍高いという結果が出ています。さらに、平均修復時間(MTTR)は40%短縮されるというデータも報告されています。(出典:Google Research, “State of DevOps Report 2025″)

※この記事にはPRが含まれます

この記事では、AIを活用したDevOpsの最新トレンドを深掘りし、自動化と予測分析によって開発サイクルを加速させる具体的な方法を解説します。2026年のDevOpsエンジニア、AI開発者、テックワーカーにとって必携の内容です。

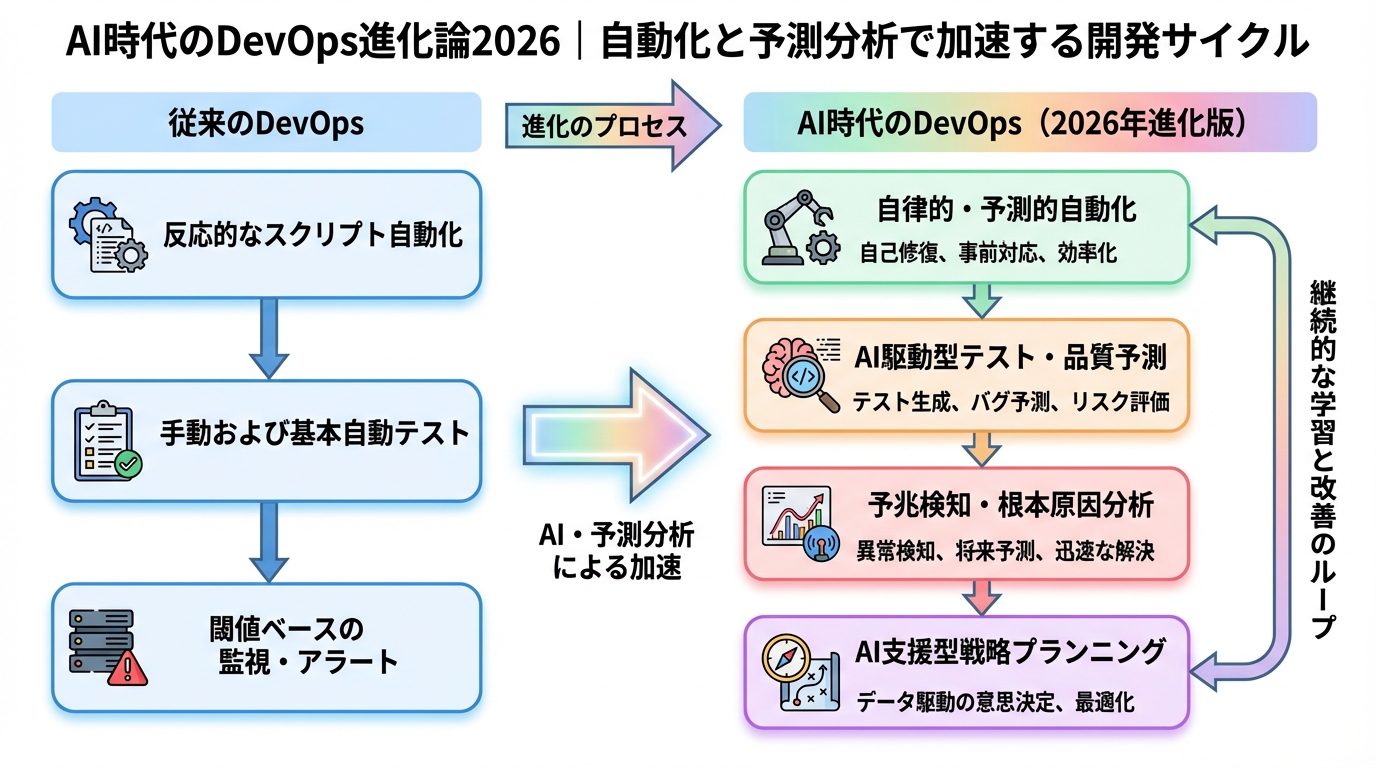

AI時代のDevOps:何が変わったのか?

従来のDevOpsは、主にCI/CDパイプラインの自動化やインフラのコード化に重点が置かれていました。しかし、AIの進化によって、DevOpsはより予測的で、自己修復的、そして高度に最適化されたものへと変貌を遂げています。

予測分析による障害の未然防止

AIは、ログデータ、メトリクス、ソースコードなどを分析し、潜在的な問題やボトルネックを予測することができます。例えば、異常検知アルゴリズムは、CPU使用率、メモリ消費量、ネットワークトラフィックなどの異常なパターンを検出し、障害が発生する前にアラートを生成します。

具体例として、あるeコマース企業では、AIによる予測分析を導入した結果、ダウンタイムが25%削減され、顧客満足度が向上しました。

自動修復による迅速な問題解決

AIは、問題発生時に自動的に診断を行い、修復プロセスを実行することができます。例えば、Kubernetes環境でPodがクラッシュした場合、AIは自動的に新しいPodを起動し、サービスを復旧させることができます。

AWS Fault Injection Simulator (FIS)のようなツールと組み合わせることで、意図的に障害を発生させ、AIの自動修復能力をテストすることも可能です。

継続的な最適化によるパフォーマンス向上

AIは、アプリケーションのパフォーマンスを継続的に監視し、ボトルネックを特定し、最適化のための提案を行うことができます。例えば、データベースクエリの最適化、キャッシュ戦略の改善、ロードバランシングの調整など、様々な側面からパフォーマンスを向上させることができます。

Google Cloud Profilerのようなツールは、AIによるパフォーマンス分析を支援し、コードレベルでのボトルネックを特定することができます。

AI DevOps 実践:具体的な導入ステップ

ここからは、AIをDevOpsに導入するための具体的なステップを解説します。

ステップ1:データ収集と分析基盤の構築

AIを活用するためには、まず十分な量のデータを収集し、分析するための基盤を構築する必要があります。ログデータ、メトリクス、ソースコード、イベントデータなど、様々な種類のデータを収集し、一元的に管理できるデータレイクを構築しましょう。

具体的には、Elasticsearch, Fluentd, Kibana (EFK) スタックや、Splunkのようなツールを活用することができます。

ステップ2:AIモデルのトレーニングとデプロイ

収集したデータを用いて、AIモデルをトレーニングします。障害予測、異常検知、パフォーマンス最適化など、目的に応じた適切なモデルを選択し、機械学習フレームワーク(TensorFlow, PyTorchなど)を用いてトレーニングを行います。

トレーニング済みのモデルは、Kubernetes, Docker, AWS SageMakerなどのプラットフォームにデプロイし、APIとして公開します。

ステップ3:自動化パイプラインへの統合

トレーニング済みのAIモデルを、既存のCI/CDパイプラインに統合します。例えば、デプロイ前にAIによるテストを実行し、潜在的な問題を検出することができます。また、運用環境でAIによる監視を行い、異常を検知した場合に自動的にロールバックすることができます。

Jenkins, GitLab CI, CircleCIなどのCI/CDツールは、APIを通じてAIモデルと連携することができます。

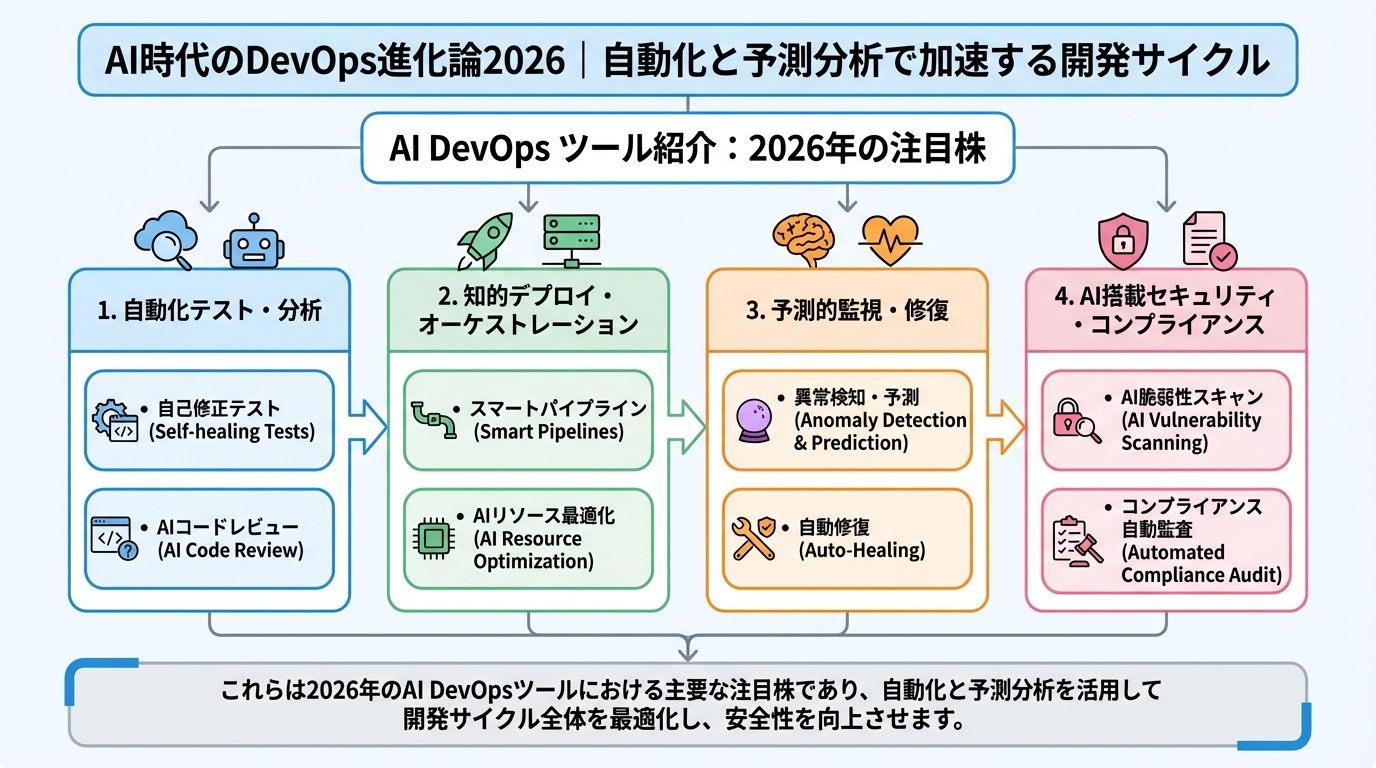

AI DevOps ツール紹介:2026年の注目株

2026年現在、AI DevOpsを支援する様々なツールが登場しています。ここでは、特に注目すべきツールをいくつか紹介します。

Keptn:AIを活用した自動デプロイメントと最適化

Keptnは、AIを活用して自動デプロイメントと最適化を行うことができるオープンソースのプラットフォームです。パフォーマンス、信頼性、セキュリティなどの指標を定義し、AIが自動的にデプロイメント戦略を調整します。

Keptnは、Istio, Prometheus, Grafanaなどのツールと統合されており、Kubernetes環境での利用に最適化されています。

CloudForecast:AIによるクラウドコスト最適化

CloudForecastは、AIを活用してクラウドコストを最適化するSaaSプラットフォームです。過去の利用状況を分析し、将来のコストを予測し、リソースの使用状況を最適化するための提案を行います。

CloudForecastは、AWS, Azure, GCPなどの主要なクラウドプラットフォームに対応しています。

Dynatrace:AIを活用したフルスタック監視

Dynatraceは、AIを活用したフルスタック監視プラットフォームです。アプリケーション、インフラ、ネットワークなど、あらゆるレイヤーを監視し、問題の原因を自動的に特定します。

Dynatraceは、AIによる根本原因分析(Root Cause Analysis)機能を搭載しており、問題解決時間を大幅に短縮することができます。

コード例:Python + scikit-learnでの異常検知

以下は、Pythonのscikit-learnライブラリを使用して、CPU使用率の異常を検知する簡単なコード例です。

“`python

import numpy as np

from sklearn.ensemble import IsolationForest

# CPU使用率のデータ(サンプル)

cpu_usage = np.array([10, 12, 15, 11, 13, 70, 14, 16, 12, 11]).reshape(-1, 1)

# Isolation Forestモデルの作成

model = IsolationForest(n_estimators=100, contamination=’auto’, random_state=42)

# モデルのトレーニング

model.fit(cpu_usage)

# 異常スコアの予測

anomaly_scores = model.decision_function(cpu_usage)

# 異常値の検出

anomaly_mask = anomaly_scores < 0 print('CPU Usage:', cpu_usage.flatten())

print('Anomaly Scores:', anomaly_scores)

print('Anomaly Mask:', anomaly_mask)

```

このコードは、Isolation Forestアルゴリズムを使用して、CPU使用率のデータから異常値を検出します。`contamination`パラメータは、データセット内の異常値の割合を表します。この例では、`’auto’`に設定されており、モデルが自動的に異常値の割合を推定します。

今後の展望:AI DevOpsの進化はどこへ向かうのか?

AI DevOpsは、今後もますます進化し、開発サイクルのさらなる高速化、品質向上、コスト削減に貢献することが期待されます。予測分析の精度向上、自動修復の範囲拡大、継続的な最適化の高度化など、様々な側面で進化が期待されます。

自己学習型DevOps

将来的には、AIがDevOpsパイプライン全体を自己学習し、自動的に最適化する「自己学習型DevOps」が実現する可能性があります。AIは、過去のデータに基づいて最適なデプロイメント戦略を学習し、問題発生時に最適な修復方法を自動的に選択することができます。

DevSecOpsへの統合

AIは、セキュリティテストの自動化、脆弱性の早期発見、脅威の予測など、DevSecOpsの領域でも重要な役割を果たすことが期待されます。AIは、セキュリティリスクを継続的に監視し、自動的にセキュリティ対策を講じることができます。

量子コンピューティングとの融合

量子コンピューティングの進化により、AI DevOpsは、より複雑な問題解決や最適化が可能になる可能性があります。例えば、量子機械学習アルゴリズムは、大規模なデータセットを高速に処理し、より高精度な予測モデルを構築することができます。

AI DevOpsは、2026年以降もエンジニアリングの現場を大きく変革していくでしょう。常に最新の技術トレンドを追いかけ、積極的に導入していくことが、競争力を維持するための鍵となります。